说实话,刚接触AI开发那会儿,我特单纯,代码里直接就写上https://api.openai.com/v1,结果呢?要么网络不通,要么跨域报错,最气人的是那帮国外的API动不动就抽风,搞得我半夜爬起来看服务器日志,那叫一个酸爽。直到有一天,我被群里的老哥点醒了——你咋不搞个本地AI接口代理地址呢?

今天这篇文,我就把这一年来踩过的坑、试过的工具,还有那个让我彻底告别网络焦虑的本地AI接口代理地址是什么这档子事儿,掰开揉碎了讲给你听。全是干货,没废话,看完你也能自己搭个AI网关,想连哪家连哪家!

一、被逼出来的“本地代理”:从崩溃到真香

事情是这样的,去年我接了个活儿,要给一个企业做内部AI助手。需求不复杂,就是用他们内部的私有模型,对接钉钉机器人,让员工能随时问问题。我心想,这不小菜一碟嘛?结果一上手,傻了。

痛点一:模型在本地,咋让外面访问? 他们那模型跑在内网服务器上,IP是http://192.168.x.x:8080,但钉钉的机器人要求接口必须是公网能访问的,而且还得支持HTTPS。我那会儿哪懂什么代理啊,差点就去申请公网IP了。

痛点二:API地址换来换去,烦都烦死了。 开发环境用的是一个地址,测试环境又是一个,到了生产环境还得改。代码里到处都是base_url的配置,稍微改错一个字符,整个服务就崩了。那段时间,我的发际线肉眼可见地往后移。

痛点三:跨域!又是跨域! 前端同学直接调本地接口,浏览器直接报CORS错误。我那时候还不信邪,让前端改配置,让后端加头,折腾了两天,最后还是没搞定。

后来我才知道,这些痛点其实只需要一个本地AI接口代理地址就能解决。简单说,它就是个“中间人”,你在代码里只管往这个本地代理地址发请求,至于这个请求是转到云端OpenAI,还是转到你本地的小模型,还是绕到某个国外服务器去,全由代理说了算。

打个比方,这个代理就像是你的AI“路由器”,你只需要记住它的地址,比如http://localhost:9017/v1,剩下的路由、转发、鉴权、负载均衡,它全包了。我第一次用上这玩意儿的时候,差点感动哭了——原来代码可以写得这么干净!

二、三个场景告诉你,“本地AI接口代理地址”到底有多香

光说概念可能有点虚,我直接给你讲三个我真实用过的场景,你就明白这玩意儿是刚需。

场景一:绕开地域限制,丝滑访问OpenAI

这个我估计很多人都遇到过。你明明有OpenAI的API Key,但服务器在国内,直接访问就是“Connection refused”。那会儿网上各种教程让你搭梯子,但梯子不稳定不说,还容易被封。

后来我找到了一个神器,叫@ai-ql/api-proxy,这东西可以Docker一键部署-1。你只需要在服务器上跑一条命令:

sudo docker run -d -p 9017:9017 aiql/api-proxy:latest然后你的本地AI接口代理地址就是http://你的服务器IP:9017/v1。你在代码里把原来的api.openai.com换成这个地址,所有请求就通过这个代理转发到OpenAI了,完全绕过了地域限制-1。最骚的是,你还可以自定义Host头,甚至跳过TLS证书验证,对那些自签名证书的企业内网特别友好-1。

场景二:多个模型一键切换,不再改代码

我现在手上项目多了,用的模型也杂。有的用阿里的千问,有的用智谱的Coding Plan,有的用本地的Ollama跑Llama3。以前每次换模型都得改代码里的base_url和api_key,烦得要命。

后来我搭了一个Helicone AI Gateway,这是个开源的AI网关,支持100多种模型-4。我的本地AI接口代理地址就固定成了http://localhost:8080/v1,然后通过配置文件来指定具体用哪个模型:

model_list: - model_name: qwen litellm_params: model: openai/qwen api_base: https://dashscope.aliyuncs.com/compatible-mode/v1 api_key: sk-xxx - model_name: local-llama litellm_params: model: openai/llama3 api_base: http://localhost:11434/v1 api_key: fake-key

你想用哪个模型,就在请求里传model: qwen或者model: local-llama,代码其他地方根本不用动-8。这种感觉就像你家里装了个万能遥控器,电视、空调、音响随便切,再也不用到处找遥控器了。

场景三:本地开发调试,前端再也不求人

这个场景前端同学应该深有体会。你在本地起了一个服务,端口是8080,想让前端页面调你的接口,结果浏览器报跨域。以前的做法是后端加CORS头,或者前端开代理,但总归麻烦。

现在有更简单的办法:用local-cors-proxy这个工具-7。你只需要:

npm install -g local-cors-proxy lcp --proxyUrl http://localhost:8080 --proxyPartial '' --origin 'http://你的前端域名'

然后你的本地AI接口代理地址就是http://localhost:8010/api,前端只管往这个地址发请求,跨域问题自动解决-7。我当时把这个方法教给我们前端小哥,他激动得差点请我喝奶茶。

三、手把手教你搭一个:从零到一

说了这么多,你可能已经心痒痒了。行,我直接给你一个最简单的搭建方案,保证你10分钟内就能跑起来一个本地AI代理。

我选的是@ai-ql/api-proxy,因为它最简单,一行命令搞定,而且支持Docker和NPX两种方式-1。

如果你有Node环境:

npx @ai-ql/api-proxy默认会监听9017端口,你的本地AI接口代理地址就是http://localhost:9017-1。

如果你想持久化运行(比如放服务器上):

docker run -d -p 9017:9017 \ -e TARGET="https://api.openai.com" \ -e PORT="9017" \ aiql/api-proxy:latest

这里TARGET就是你想要代理的目标地址,默认是OpenAI的地址,你可以换成任何你想用的API地址,比如阿里的、智谱的,甚至你本地跑的一个模型地址-1。

你在代码里这么用:

from openai import OpenAI 这里的base_url就是你的本地代理地址 client = OpenAI( api_key="随便填,反正代理那边会处理", base_url="http://localhost:9017/v1" ) response = client.chat.completions.create( model="gpt-4", 具体用哪个模型,取决于你TARGET指向的服务 messages=[{"role": "user", "content": "你好"}] )

就这么简单!你现在可以随便换后端模型,只要改一下Docker容器的TARGET环境变量,代码一行都不用动。

四、一些你可能踩到的坑,我提前帮你踩了

坑一:端口被占用了怎么办?

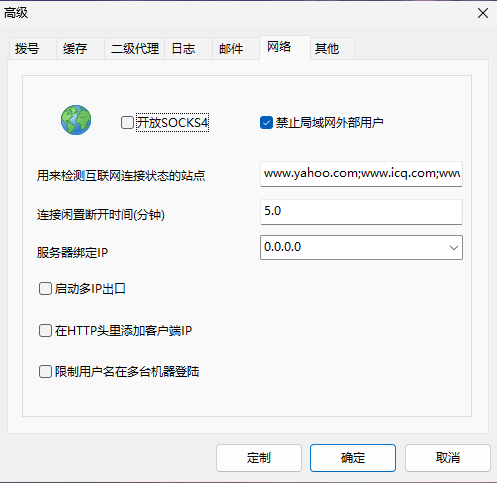

启动的时候指定一个别的端口就行,比如-p 9018:9017,你的代理地址就变成了http://localhost:9018-1。

坑二:本地模型跑不起来,显存不够?

如果是想代理本地的Ollama模型,你得先确认你机器配置够不够。我自己的经验是,8G显存可以跑qwen2.5:7b或者llama3.1:8b,4G显存就老实跑phi4-mini或者qwen2.5:1.5b-9。千万别硬上大模型,不然OOM了别说我没提醒你。

坑三:代理能支持Function Calling吗?

这取决于你后端的模型支不支持。如果你用的是qwen2.5系列或者llama3.1系列,它们原生支持工具调用,代理转发过去是完全没问题的-9。但如果你用的是codellama或者llama2,那就不支持了,技能会失效。

坑四:我想在外面(公网)访问这个本地代理怎么办?

如果你把代理搭在阿里云或者腾讯云上,记得在安全组里放行你用的端口。比如默认的9017端口,得在防火墙里开一下-3。另外,如果你不想暴露端口,可以用Nginx反代加上HTTPS,配置稍微复杂点,但更安全-1。

写在最后

现在回过头看,那个让我掉头发的本地AI接口代理地址,其实解决的不是技术问题,而是开发体验问题。它让AI应用的开发变得像搭积木一样简单——你只管写业务逻辑,路由、转发、鉴权这些脏活累活,全丢给代理去干。

如果你也像我当初一样,被各种API地址搞得焦头烂额,不妨试试搭一个本地代理。相信我,当你第一次把代码里所有的API地址都换成http://localhost:9017,然后发现整个世界都清净了的时候,你会回来感谢我的。

网友问1:我是纯小白,就想在自己电脑上跑个AI玩玩,不想买服务器也不想折腾Docker,有最简单的方案吗?

有的兄弟!你这种情况最合适的就是本地跑Ollama加上OpenClaw,完全免费,而且隐私安全。首先去Ollama官网下载安装包,双击安装。然后在命令行跑ollama pull qwen2.5:7b,等它下载完(大概4个G),再跑ollama run qwen2.5:7b,你就拥有了一个本地的AI对话模型-9。但这只是个模型,要让它变成能干活、能调API的智能体,你还需要装OpenClaw。打开终端(Windows用管理员PowerShell),执行npm install -g openclaw,然后openclaw onboard走一遍初始化流程,它会问你要用哪个模型,你选Ollama,填上http://localhost:11434,搞定!现在你的本地AI接口代理地址就是OpenClaw默认的网关地址http://localhost:18789,你可以通过这个地址访问你的本地AI了-2-9。整个过程不用花一分钱,也不用买服务器,纯本地运行。

网友问2:我公司内网有个自建的AI服务,接口地址是内网IP,我想在钉钉机器人里调用它,但钉钉要求公网域名和HTTPS,怎么破?

这个问题问得很典型,我当初做企业项目时也遇到过。解法是用一台有公网IP的云服务器(比如阿里云的轻量应用服务器)做反向代理。具体操作分三步:第一步,在云服务器上装Nginx,配置一个域名指向这台服务器(比如ai.yourcompany.com)。第二步,在Nginx配置里写一个location,把来自这个域名的请求转发到你内网的AI服务地址,核心配置是proxy_pass http://内网IP:端口;。第三步,申请免费的SSL证书(阿里云有免费的一年期证书),在Nginx里配置HTTPS-1。完成之后,你的钉钉机器人里填的接口地址就是https://ai.yourcompany.com/v1,但实际上请求被Nginx转发到了内网的AI服务。如果你不想手动配Nginx,也可以直接用Docker跑一个@ai-ql/api-proxy,在启动时设置TARGET为你的内网地址,再配合Nginx做HTTPS转发,效果一样-1。最关键的是,你得在云服务器的安全组里放行443和80端口,不然外网访问不到。

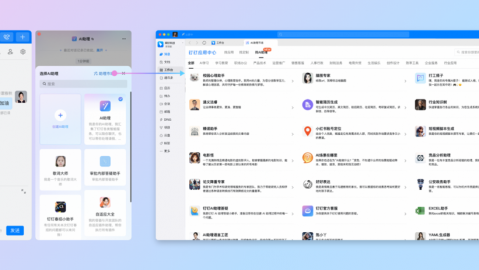

网友问3:我同时用好几个云厂商的AI服务,OpenAI、阿里千问、智谱都有,每次换着用特别麻烦,有什么办法统一管理吗?

太有了,你这种情况最适合上AI网关,我推荐Helicone AI Gateway或者LiteLLM。我用的是LiteLLM,因为它配置起来最简单。你先在本地写一个配置文件litellm_config.yaml,把你要用的几家服务都配进去-8:

model_list: - model_name: openai-gpt litellm_params: model: openai/gpt-4o api_key: sk-xxx - model_name: qwen-max litellm_params: model: openai/qwen-max api_base: https://dashscope.aliyuncs.com/compatible-mode/v1 api_key: sk-xxx - model_name: zhipu-coding litellm_params: model: openai/glm-4-plus api_base: https://open.bigmodel.cn/api/paas/v4 api_key: xxx

然后启动网关:litellm --config litellm_config.yaml --port 4000。现在你的本地AI接口代理地址就是http://localhost:4000/v1,你调用的时候只需要在请求里指定model参数,网关会自动帮你转发到对应的服务商-8。比如你想用OpenAI就传model: openai-gpt,想用千问就传model: qwen-max,完全不需要改代码里的base_url。这玩意儿还自带成本追踪和限流功能-4,对团队协作特别友好。如果你想把网关部署在服务器上供整个团队用,记得加上--host 0.0.0.0参数让它可以被外部访问,然后在防火墙里放行4000端口。